如何通過K折交叉驗證大幅降低機器學習核心參數(shù)估計偏差?揭秘Chernozhukov的漸近無偏證明

如今,在數(shù)據(jù)科學領(lǐng)域,降低機器學習算法收斂速度慢對關(guān)鍵參數(shù)造成的影響成了一大難題,這個問題涉及諸多值得深入研究的內(nèi)容。

降低核心參數(shù)影響的方法

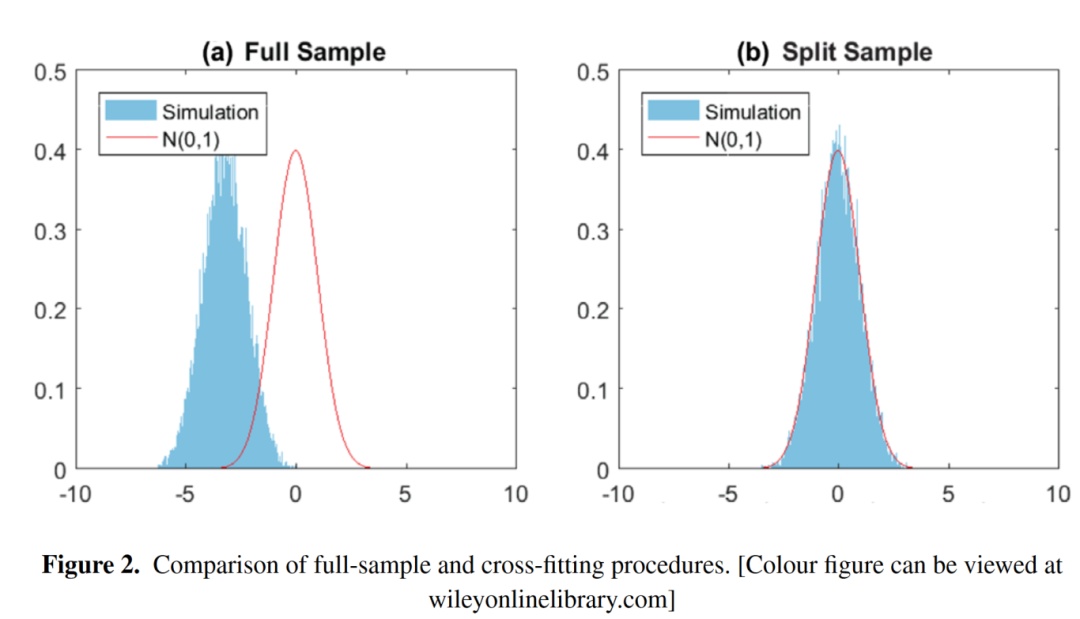

在雙重機器學習領(lǐng)域,有一種特別的方法。它將樣本隨機劃分為K組,就好比把蘋果按照一定規(guī)則分成了K堆。每次,我們剔除一組數(shù)據(jù)來訓(xùn)練機器學習模型,然后用這個模型來調(diào)整核心參數(shù)。這個過程要重復(fù)K次。這種方式在一定程度上打破了常規(guī),創(chuàng)造了一種新的判斷核心參數(shù)影響的方法。這種方法適用于那些機器學習算法收斂速度慢且核心參數(shù)影響顯著的情況,為處理這類問題提供了新的思路。這種做法并非空想,而是基于實踐和研究得出的。

理論上講,這種隨機分配樣本的方法為數(shù)據(jù)提供了多種組合途徑以供模型學習。這使數(shù)據(jù)的豐富性在訓(xùn)練過程中得到了強調(diào)。同時,各種組合的數(shù)據(jù)在訓(xùn)練后對關(guān)鍵參數(shù)的作用也發(fā)生了重新分配。因此,可以有效減少對關(guān)鍵參數(shù)估計的誤差。

理論支持與證明

2018年,Chernozhukov等人證實,完成前述兩步后,關(guān)鍵參數(shù)的估算趨于無偏且呈漸近正態(tài)分布。這一理論成果為該方法的正確性與實效性奠定了堅實的理論基礎(chǔ)。這就像在黑暗中點亮了一盞燈。有了這一證明,研究人員便可以放心地在相關(guān)領(lǐng)域應(yīng)用這一方法。

它還如同一個衡量準則。憑借它,后續(xù)的研究或應(yīng)用一旦出現(xiàn)誤差,便可依據(jù)此理論進行調(diào)整。這成為該方法拓展至更廣范圍的通行證。若缺少這一理論作為支撐,其在實際應(yīng)用中的說服力或許會顯著減弱。

部分線性回歸模型中的應(yīng)用

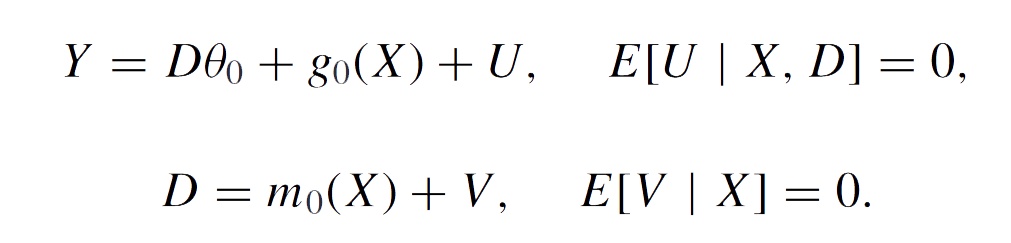

在簡單的線性回歸模型中,例如與實際生產(chǎn)和日常生活相關(guān)的模型,其關(guān)鍵參數(shù)是θ0。對于未知的函數(shù)或高維的冗余參數(shù),估計核心參數(shù)需要遵循明確步驟。首先,需要對數(shù)據(jù)進行劃分,以IIK數(shù)據(jù)為例,將Y和D分別作為標簽,X作為輸入,用于訓(xùn)練機器學習模型。簡單來說,這就像是在構(gòu)建一座橋梁,Y和D是橋梁的兩端,而X則是中間的支撐結(jié)構(gòu)。

接著,重復(fù)上述步驟K次以獲得樣本外殘差,隨后,將Y的殘差視為因變量,D的殘差作為自變量,通過普通最小二乘法進行回歸,以估算θ0。這一過程猶如在迷宮中尋找出路,每一步都是通往核心參數(shù)的目標路徑。這一系列回歸操作實現(xiàn)了Neyman正交化,從而使得雙重機器學習既具備了Neyman正交化的優(yōu)勢,又享有了交叉擬合的益處。

實際研究案例

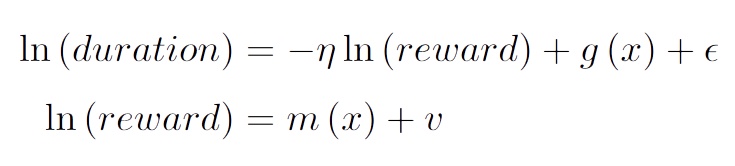

2020年,Dube等人在探討在線勞動市場的勞動供給彈性時,采用了這一方法。在Mturk平臺上,雇主發(fā)布任務(wù),勞動者按需完成任務(wù)以獲得報酬。任務(wù)時長和報酬與任務(wù)內(nèi)容緊密相連,而變量x則包含眾多固定因素。然而,該模型在處理任務(wù)難度與報酬關(guān)聯(lián)性問題上存在挑戰(zhàn),且由于x維度眾多,直接分析變得較為復(fù)雜。

他們采用Doc2Vec和詞袋模型來擴展任務(wù)標題和描述的文本維度,接著用隨機森林擬合部分線性模型,從而獲得無偏估計。這一做法將抽象的雙重機器學習方法應(yīng)用于實際場景,就如同將理論公式用于實際工程設(shè)計,展示了其在復(fù)雜現(xiàn)實中的實用價值。

廣泛的應(yīng)用領(lǐng)域

在經(jīng)濟和統(tǒng)計學研究的眾多領(lǐng)域中,雙重機器學習正逐漸被廣泛采用。以因果推斷為例,Chernozhukov在2017年采用了一種雙向穩(wěn)健的方法,對無混淆分配假設(shè)下的平均處理效應(yīng)以及處理組平均處理效應(yīng)的估計問題進行了探討,并應(yīng)用了相關(guān)技術(shù)。在其他經(jīng)濟統(tǒng)計領(lǐng)域,也有各種不同的研究情境,例如在分析消費行為與市場環(huán)境的關(guān)系時,一旦遇到需要精確估計關(guān)鍵參數(shù)的情況,這種方法便能發(fā)揮其作用。

每個應(yīng)用場景都證明了這種方法的有效性。它就像一塊塊疊加的基石,讓這種方法在多個學科中穩(wěn)固立足。隨著應(yīng)用范圍的擴大,該方法也在持續(xù)地得到優(yōu)化和提升。

未來發(fā)展展望

盡管雙重機器學習已在多個領(lǐng)域得到應(yīng)用,但仍有廣闊的發(fā)展前景。比如,面對更復(fù)雜的數(shù)據(jù)結(jié)構(gòu)或不同模型假設(shè),現(xiàn)有模式可能需作調(diào)整。在數(shù)據(jù)量持續(xù)膨脹的當下,增長速度的加快或許會引發(fā)新的挑戰(zhàn)。

新的混合模型能否在雙重機器學習的基礎(chǔ)上實現(xiàn)創(chuàng)新?又或者,在分析特定行業(yè),比如環(huán)保行業(yè)碳排放與經(jīng)濟發(fā)展關(guān)系時,雙重機器學習應(yīng)如何更有效地發(fā)揮作用?這些問題都值得我們深入探討。

你認為雙重機器學習今后會有怎樣的改進?期待大家積極參與討論,并給予點贊和轉(zhuǎn)發(fā)。

作者:小藍

鏈接:http://www.yunyix1.cn/content/6988.html

本站部分內(nèi)容和圖片來源網(wǎng)絡(luò),不代表本站觀點,如有侵權(quán),可聯(lián)系我方刪除。